Прежде чем перейти к статье, хочу вам представить, экономическую онлайн игру Brave Knights, в которой вы можете играть и зарабатывать. Регистируйтесь, играйте и зарабатывайте!

Рассказываем, что нового может появиться в дата-центрах и не только в них.

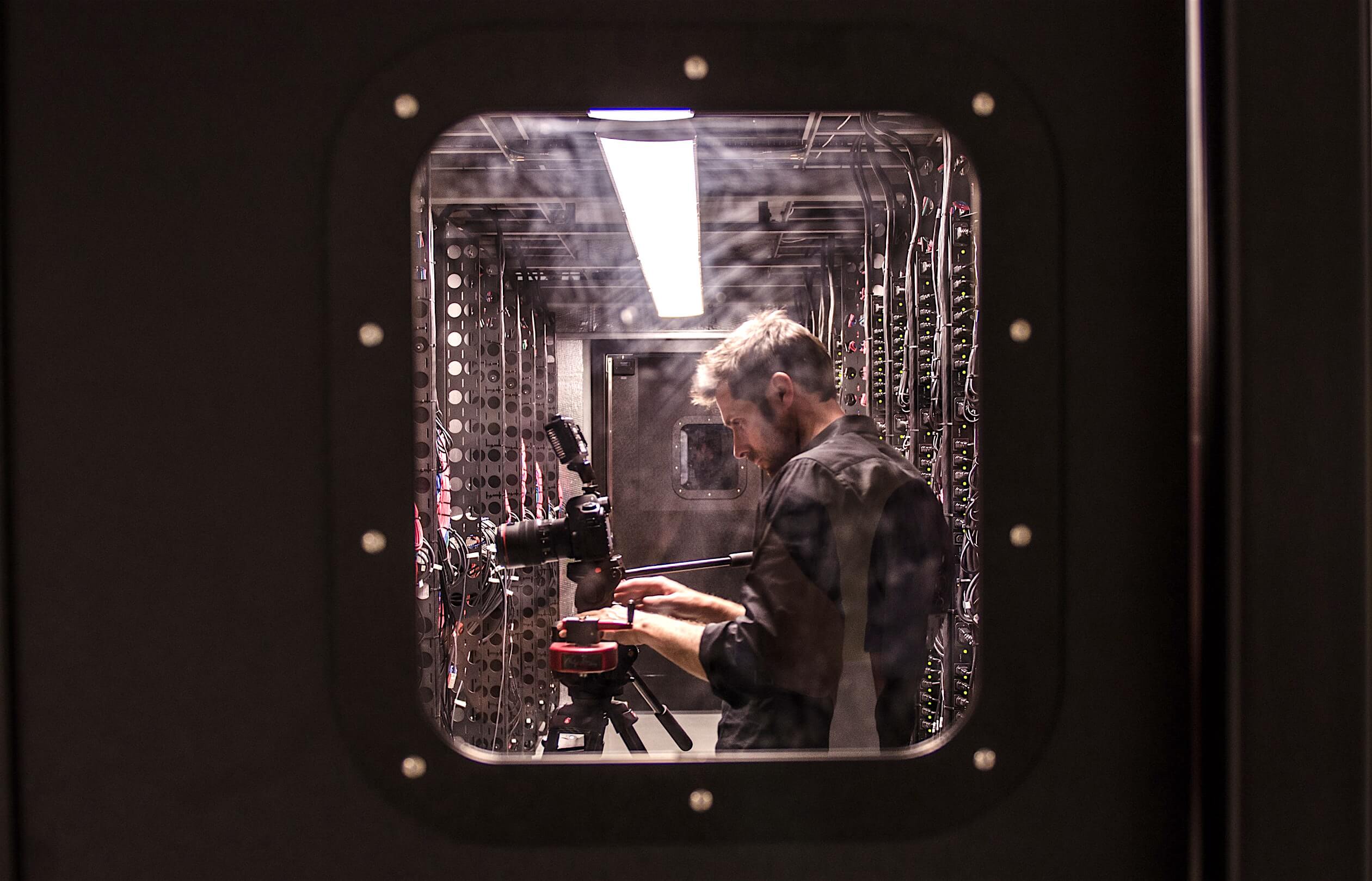

/ фото jesse orrico Unsplash

Считается, что кремниевые транзисторы приближаются к своему технологическому пределу. В прошлый раз мы рассказывали о материалах, которые могут заменить кремний и обсуждали альтернативные подходы к разработке транзисторов. Сегодня говорим о концепциях, способных трансформировать принципы работы традиционных вычислительных систем: квантовых машинах, нейроморфных чипах и компьютерах на основе ДНК.

ДНК-компьютеры

Это — система, которая использует вычислительные возможности молекул ДНК. Нити ДНК состоят из четырех азотистых оснований: цитозина, аденина, гуанина и тимина. Связывая их в определенной последовательности, можно кодировать информацию. Для изменения данных используют специальные ферменты, которые с помощью химических реакций достраивают цепочки ДНК, а также разрезают и укорачивают их. Такие реакции можно проводить в разных частях молекулы одновременно, что позволяет выполнять параллельные вычисления.

Первый компьютер на базе ДНК представили в 1994 году. Профессор молекулярной биологии и компьютерных наук Леонард Адлеман (Leonard Adleman) использовал несколько пробирок с миллиардами молекул ДНК, чтобы попытаться решить задачу коммивояжера для графа с семью вершинами. Его вершины и ребра Адлеман обозначил фрагментами ДНК с двадцатью азотистыми основаниями, а затем применил метод полимеразной цепной реакции (ПЦР).

Недостатком компьютера Адлемана была его «узконаправленность». Он был заточен под решение одной задачи и не мог выполнять другие. С тех пор ситуация изменилась — в конце марта ученые из университета Мейнут и Калифорнийского технологического института представили компьютер, данные в который загружаются в виде последовательностей ДНК и могут быть перепрограммированы.

Система способна открыть дорогу новому типу вычислительных систем, осталось решить проблему с медленным вводом и выводом данных (процесс секвенирования довольно дорогостоящий и занимает длительное время).

Несмотря на сложности, эксперты говорят, что в перспективе ДНК-компьютеры размером с современные десктопы обойдут по производительности суперкомпьютеры. Они смогут найти применение в дата-центрах, занимающихся обработкой больших сводов данных.

Нейроморфные процессоры

Термин «нейроморфный» обозначает, что архитектура чипа основывается на принципах работы человеческого мозга. Такие процессоры эмулируют работу миллионов нейронов с отростками, которые называются аксонами и дендритами. Первые отвечают за передачу информации, а вторые — за её восприятие. Нейроны соединены между собой синапсами — специальными контактами, по которым передаются электрические сигналы (нервные импульсы).

Впервые идея создания нейроморфных систем появилась еще в 1990-х. Но всерьез разработками в этой области занялись после 2000-х. Специалисты из IBM Research запустили проект SyNAPSE, целью которого была разработка компьютера с архитектурой, отличной от архитектуры фон Неймана. В рамках этого проекта компания спроектировала чип TrueNorth. Он эмулирует работу миллиона нейронов и 256 миллионов синапсов.

Над нейроморфными процессорами трудятся не только в IBM. Компания Intel с 2017 года разрабатывает чип Loihi. В его составе 130 тысяч искусственных нейронов и 130 млн синапсов. Год назад компания завершила разработку прототипа по 14-нм техпроцессу.

Нейроморфные устройства позволяют ускорить обучение нейросетей. Таким чипам, в отличие от классических процессоров, не нужно регулярно обращаться к регистрам или памяти за данными. Вся информация постоянно хранится в искусственных нейронах. Эта особенность позволит обучать нейронные сети локально (без подключения хранилищу со сводом тестовых данных).

Ожидается, что нейроморфные процессоры найдут применение в смартфонах и устройствах интернета вещей. Но пока о масштабном внедрении технологии в пользовательские устройства говорить не приходится.

Квантовые машины

Основу квантовых компьютеров составляют кубиты. Их работа основывается на принципах квантовой физики — запутанности и суперпозиции. Суперпозиция позволяет кубиту находиться в состоянии нуля и единицы одновременно. Запутанность — это явление, при котором состояния нескольких кубитов оказываются взаимосвязанными. Такой подход позволяет проводить операции с нулем и единицей одновременно.

/ фото IBM Research CC BY-NA

Как результат — квантовые компьютеры решают ряд задач гораздо быстрее традиционных систем. Примерами могут быть построение математических моделей в финансовой, химической и медицинской областях, а также криптографические операции.

На сегодняшний день развитием квантовых вычислений занимается относительно небольшое число компаний. Среди них можно выделить IBM с их 50-кубитным квантовым компьютером, Intel с 49-кубитным и InoQ, которая тестирует 79-кубитное устройство. Также в этой области работают Google, Rigetti и D-Wave.

О массовом внедрении квантовых компьютеров пока говорить рано. Даже если не брать в расчет высокую стоимость аппаратов, они имеют серьезные технологические ограничения.

В частности, квантовые машины работают при температуре близкой к абсолютному нулю. Поэтому устанавливаются такие аппараты только в специализированных лабораториях. Это вынужденная мера для защиты хрупких кубитов, способных поддерживать суперпозицию на протяжении всего нескольких секунд (любые температурные колебания приводят к их декогеренции).

Хотя в начале года IBM представили квантовый компьютер, способный работать при комнатной температуре. Но купить аппарат пока нельзя, можно лишь арендовать его мощности через облачную платформу. Компания обещает, что в будущем этот компьютер сможет приобрести любой желающий, но когда это произойдет — пока неизвестно.

Материалы из нашего Telegram-канала:

- Что такое VMware Virtual SAN (vSAN) — изучаем основы

- Продолжаем тему виртуализации — говорим про VMware NSX

- Требования к оборудованию при размещении SAP HANA

- Тренды IT: edge computing

- Система мониторинга на кристалле процессора — зачем она нужна?

- Краткий ликбез: что такое waferscale-процессоры