Прежде чем перейти к статье, хочу вам представить, экономическую онлайн игру Brave Knights, в которой вы можете играть и зарабатывать. Регистируйтесь, играйте и зарабатывайте!

Привет, Хабр! Наконец, после множества бессонных ночей, я завершил работу над второй частью обновления open-source проекта Wunjo AI и воплотил своё видение приложения. В этом обновлении основное внимание уделено звуку: улучшено клонирование голоса, извлечение вокала или мелодии из песен и повышение качества речи. Но это не все, также появились новые функции для работы с видео и создания дипфейков. Давайте рассмотрим все по порядку: начнем с звука и перейдем к видео и дипфейкам. В конце статьи вы найдете ролик, в котором объясняется работа с видео в приложении и функционирование нейронных сетей для создания дипфейков и не только.

Если вам интересно, вы можете прочитать предыдущие статьи на Хабре о создании дипфейков в Wunjo AI и функциях работы с дипфейками и изменениями видео с помощью текста.

Давайте начнем с звука. Одной из основных задач во второй части обновления была работа над звуком. Изначально в Wunjo AI использовалась адаптированная версия Real Time Voice Cloning, но подход был полностью переработан, что привело к улучшенной версии клонирования голоса. Теперь я использую кодировщик, обученный на аудиоматериале через Real Time Voice Cloning, в сочетании с HuBERT Soft. Этот метод позволяет точнее копировать скорость и тембр речи на этапе синтеза звука и перед работой вокодера. Кроме того, на основе исходного аудио, очищенного от шумов, определяется пол голоса (мужской или женский), а затем настройки вокодера подбираются в соответствии с типом голоса.

Однако эта статья сконцентрирована на более простых аспектах без технических деталей. Давайте взглянем на процесс клонирования голоса в Wunjo AI.

Русский голос

Отрывок из песни Enjoykin — Котлетки с пюрешкой

Полная новая версия Wunjo AI теперь способна не только извлекать вокал из песен, но и клонировать голос. К тому же, появилась удобная панель для ручного отделения вокала от мелодии или шумов в аудио или видео, предоставляя больше гибкости в соответствии с вашими потребностями.

В предыдущей версии Wunjo AI мы не могли извлекать голос из песни, поэтому извлекаем вокал из песни в новой версии. Метод разделения звуков базируется на технологии Open-Unmix, обеспечивая точное извлечение голоса или аккомпанемента из песни.

Извлеченный вокал

Клонируем голос в предыдущей версии.

Как клонирование работало до улучшения

Как клонирование голоса работает в новой версии

Определенно, качество стало лучше, и сам голос был клонирован из оригинального отрывка без необходимости ручного извлечения вокала.

Английский голос

Возможно, улучшение голоса связано с моделью? Нет, модель не изменялась, и это можно доказать, клонируя английский голос с использованием базовых моделей Real Time Voice Cloning.

Отрывок из песни Tessa Violet - Crush

Извлеченный вокал для клонирования в предыдущей версии

Как клонирование работало до улучшения

Как клонирование голоса работает в новой версии

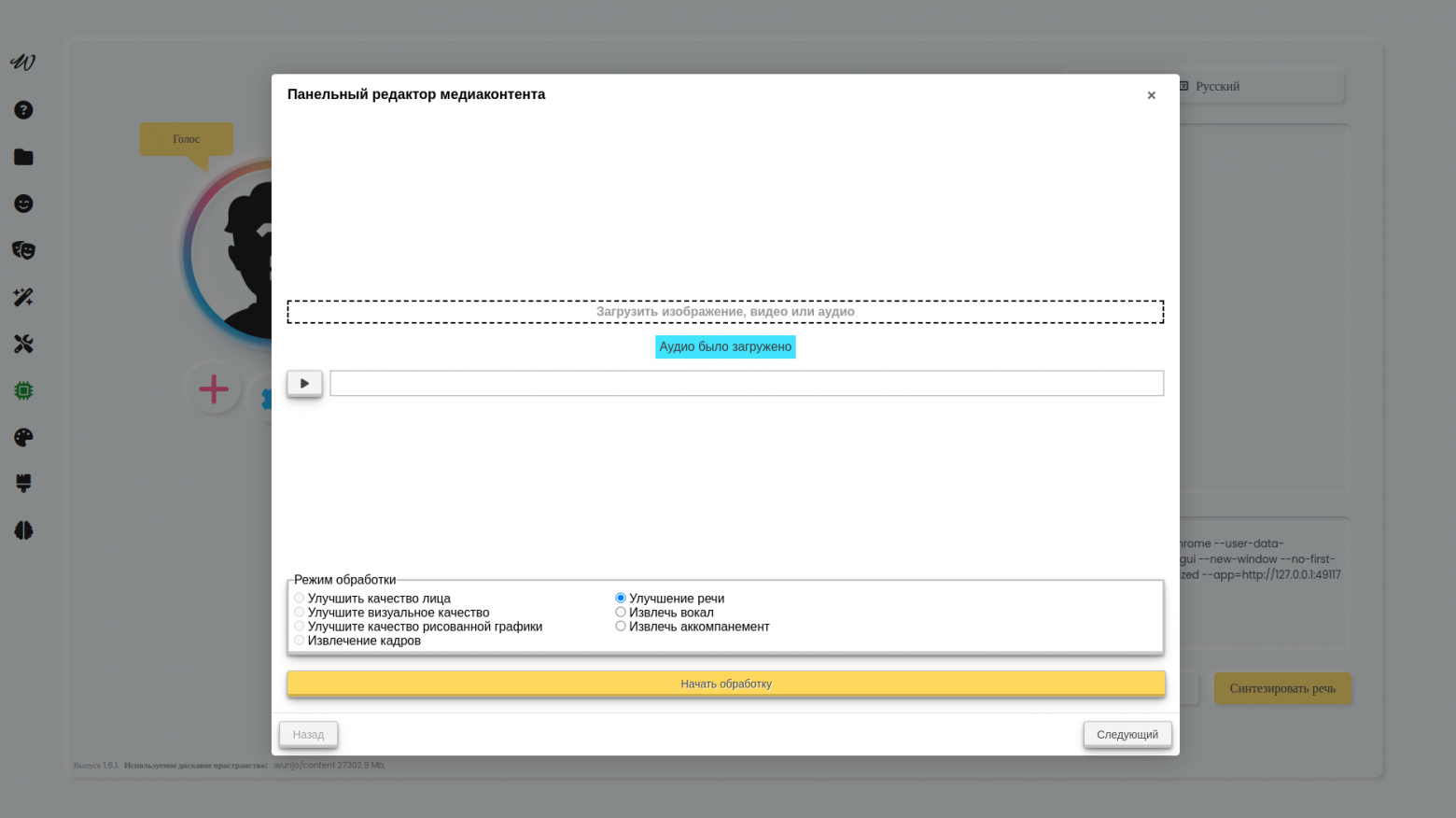

Клонируем голос на свободный текст

Однако не секрет, что подход Real Time Voice Cloning снижает частоту аудиофрагмента, и для получения наилучшего качества клонированного голоса необходимо снизить частоту входящего аудио. Любое понижение частоты аудио влечет за собой потерю качества звука. Для улучшения аудио и восстановления исходной частоты применяется технология Speech Enhancement. Улучшение речи работает как с аудио, так и с видео, направленное на повышение качества звука и восстановление исходной частоты.

Как клонирование голоса работает в новой версии + улучшение речи

Клонируем голос на свободный текст + улучшение речи

Для улучшения процесса клонирования речи была проведена значительная работа в сочетании с бессонными ночами, однако мы переходим к следующему этапу — работе с видео.

Удаление текста из видео

Была ли у вас когда-то необходимость или просто желание удалить текст из видеоролика, который появляется на весь экран, либо субтитры, либо замазать текст на упаковках каких-то брендов или продукций, либо даже на вывесках на улице в вашем видео или изображении? Мне пришла мысль, что это будет полезной функцией для пользователей Wunjo AI, позволяя им удалить текст с видео всего двумя кликами, чтобы облегчить задачу тем, кто работает над удалением текста из видеоматериалов.

Посмотрим на результат

Работает далеко не идеально, но может быть полезным в большинстве случаев.

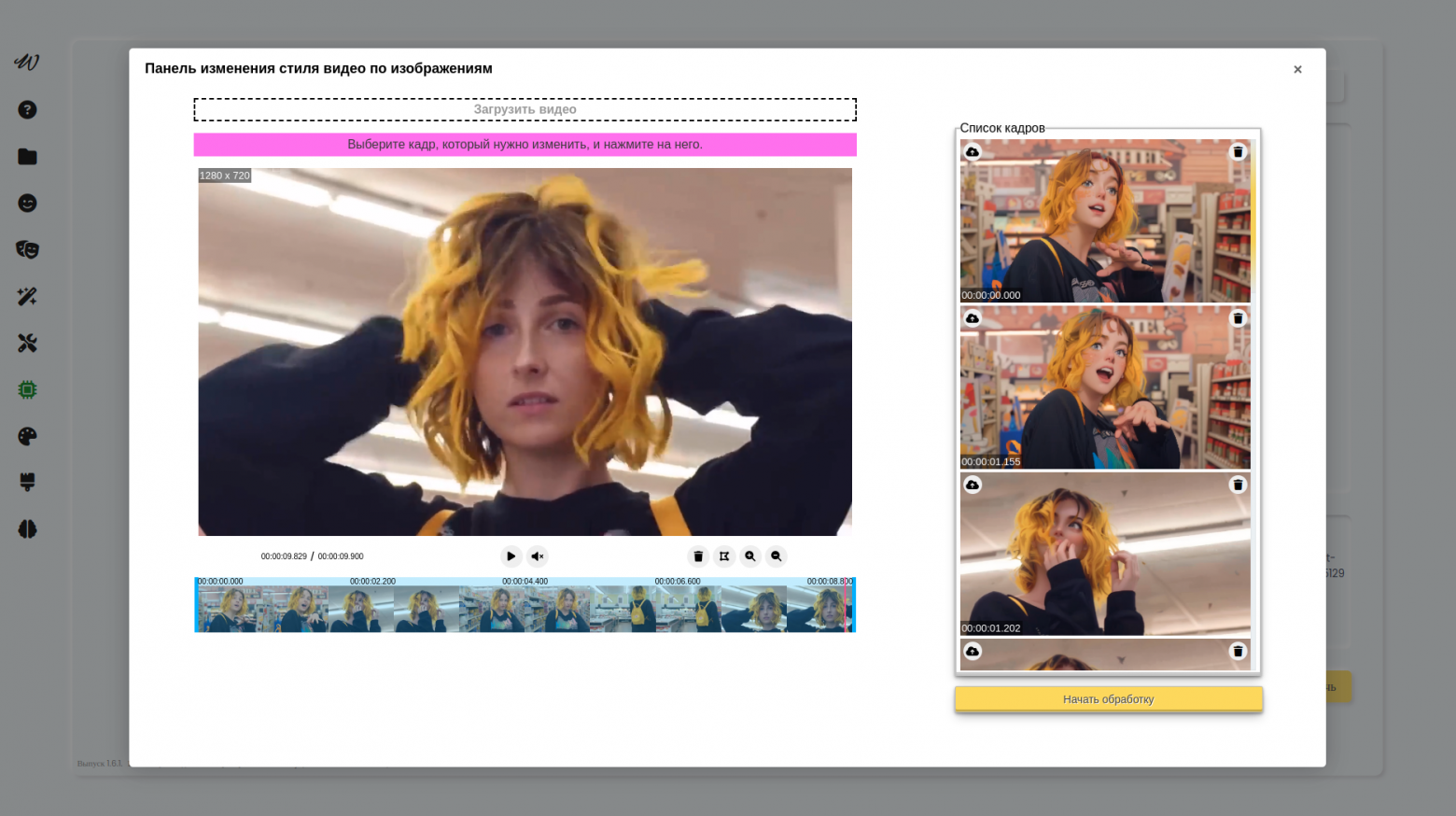

Панель изменения стиля видео

В предыдущем обновлении я добавил возможность изменения видео с использованием текста. Если вам интересно узнать о том, как это работает, то эта статья для вас.

В этом обновлении я добавил панель для работы с второй частью модуля изменения видео через видео при помощи текста. Как я упоминал в предыдущей статье, для работы такого модуля требуется большое количество видеопамяти, а у меня всего 8 Гб. Однако преимущество данного подхода заключается в том, что следующий кадр для видео создается не только на основе текущего кадра, но и данных о предыдущем, что позволяет контролировать изменения.

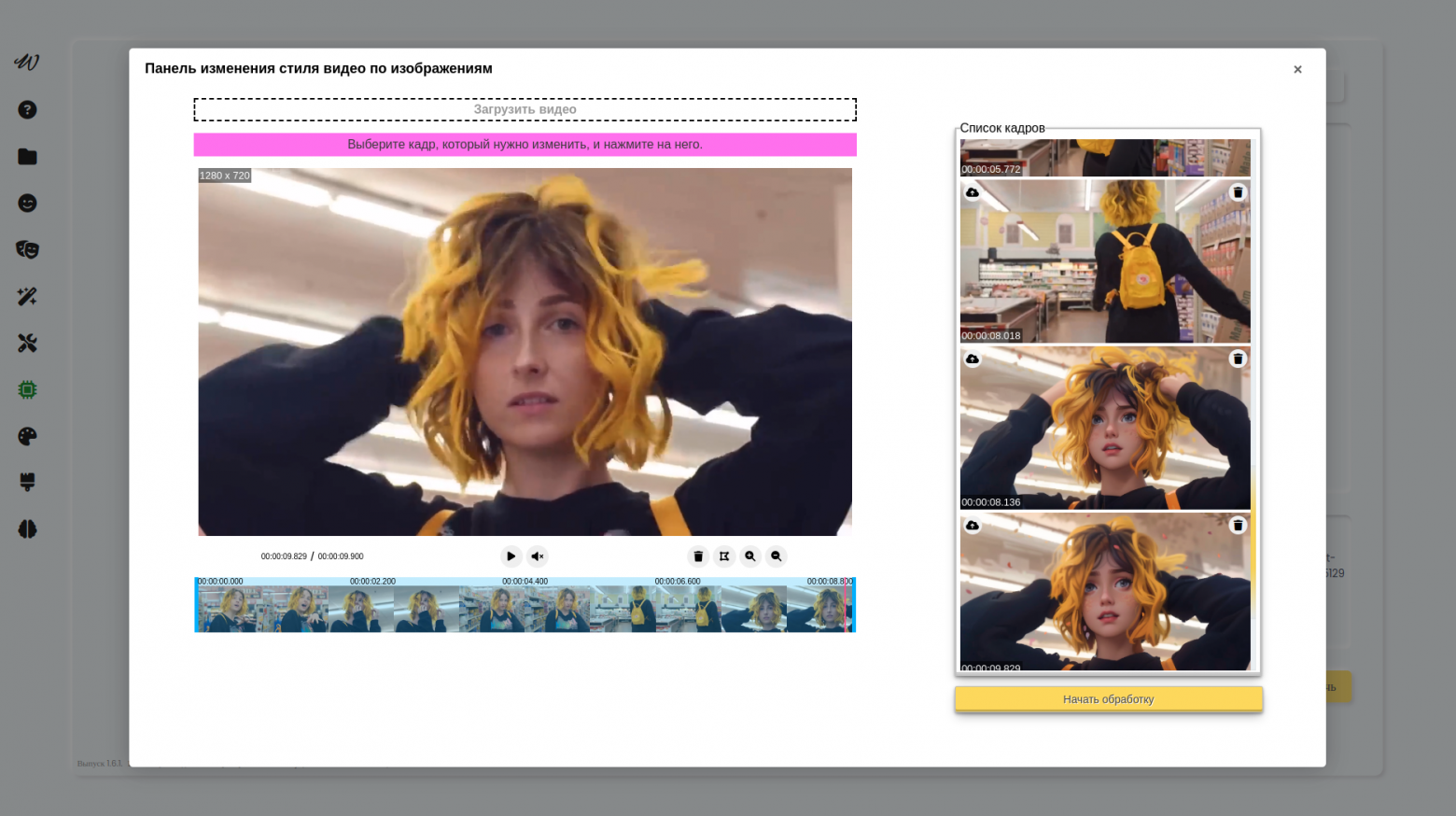

Вторая часть этого подхода менее ресурсоемкая по сравнению с первой. Например, для моего объема видеопамяти я могу работать с разрешением 1280х1280, что уже радует. В чем суть? Вы загружаете видео, выбираете ключевые кадры, где происходит резкое изменение сцен в видео, отдельно изменяете эти кадры в AUTOMATIC1111, добавляете их в панель и запускаете обработку. Стиль видео изменится благодаря EbSynth, который был немного доработан по сравнению с оригинальным репозиторием. Без первой части создание подобных картинок ложится уже на ваши плечи.

Оригинальный отрывок

Получаем результат

Даже при ограниченном объеме видеопамяти, мы можем получать более качественные результаты. Более того, в новой версии Wunjo AI добавлено улучшение качества видео.

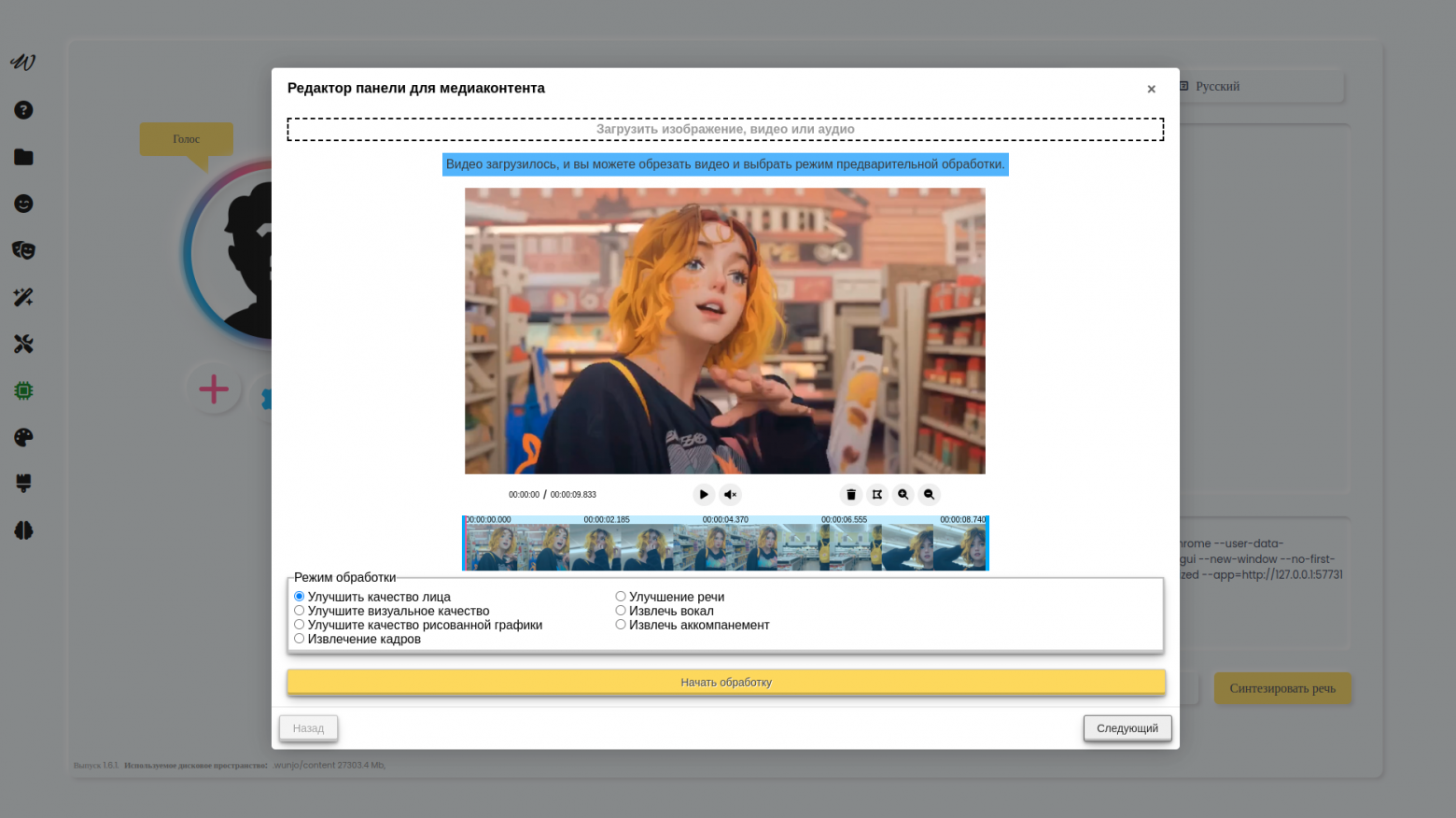

Улучшение видео

Вы можете улучшить лицо, улучшить качество видео, либо улучшить качество рисованного видео, так как подход в рисованного видео более агресивный.

Теперь вы можете улучшать не только качество лица, но и повышать качество видеороликов или улучшать визуальные аспекты рисованных видеоматериалов, так как подход к рисованным видео является более агрессивным.

Качество полученного фрагмента после сжатия видео для встраивания в GIF вряд ли будет заметно. Поэтому давайте рассмотрим другой фрагмент, специально созданный для этих целей.

Что еще?

Ранее некоторые пользователи Windows, у которых отсутствовал Visual Studio, могли столкнуться с проблемами при запуске Wunjo AI из-за требований библиотеки dlib, необходимой для работы с лицами. Теперь эта библиотека полностью заменена без добавления каких-либо новых зависимостей.

А как же дипфейки?

Работа с дипфейками была оптимизирована для менее производительных ПК с ограниченным объемом оперативной памяти (RAM). Если вы хотите узнать больше о дипфейках, о том, как работают нейронные сети внутри процесса создания дипфейков или об остальных возможностях работы с видео в проекте Wunjo AI, у меня есть видео из канала CyberYozh, которое посвящено работе с видео в Wunjo AI. Не забудьте оставить комментарий, что в этом видео сделал человек, а что нейронная сеть. Например речь изменена нейронными сетями, а что еще...

В любом случае, обещайте использовать эту технологию на благо человечества!

Если вам понравилось видео и вы хотите получить больше информации о том, как работают нейронные сети, или если вы предпочитаете чтение видео, то у меня есть свой блог об этом.

Если у вас есть вопросы о установке, новых функциях в Wunjo AI или если у вас есть предложения по улучшению приложения, для вас есть Telegram-канал и YouTube-канал. Там вы сможете узнать, как установить Wunjo AI или обучить свою собственную нейронную сеть с использованием голоса.

Документация Wunjo AI, открытый исходный код на GitHub и официальный сайт для скачивания установщиков или портативных версий с поддержкой GPU для Windows доступны для вас. Не забудьте, что для использования версии с поддержкой GPU вам потребуется установить CUDA 11.8.

Это всё! Надеюсь, вам было интересно и полезно. Пока-пока!